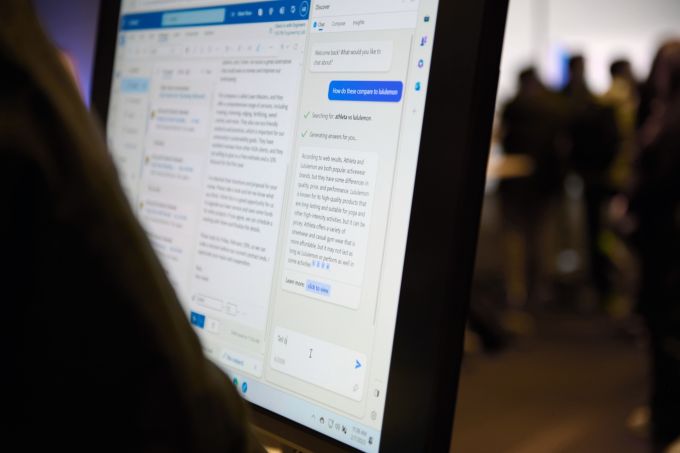

[서울=뉴스핌] 최원진 기자= 마이크로소프트(MS)가 검색엔진 빙(Bing)에 탑재한 인공지능(AI) 챗봇 문답 횟수에 제한을 걸었다.

최근 한 뉴욕타임스(NYT) 칼럼니스트가 빙 챗봇과 2시간 동안 나눈 대화 내용이 화제가 되면서 MS가 '입단속'에 나선 것이다.

18일(현지시간) 미국 IT전문 매체 더버지에 따르면 빙은 전날 블로그를 통해 챗봇 대화를 제한하겠다고 발표했다.

대화는 질문과 답변을 포함해 하루 50회, 주제 하나당 최대 5회로 채팅이 제한된다. 하루 50회를 채우면 이용자는 다음날까지 질문할 수 없다.

빙은 챗봇 문답을 제한한 이유가 "매우 장시간 지속되는 대화가 챗봇 모델을 혼란스럽게 할 수 있어서"라고 밝혔다.

15개 이상의 문답이 오갈 경우 "챗봇이 중복 답변을 하거나, 유용하지 않은 정보 제공을 할 수 있다"며 주제당 주고 받는 문답을 5회로 제한해 대화창을 '새로고침'하는 것도 이러한 이유 때문이라는 설명이다.

현재 제한된 베타 테스터를 대상으로 출시한 빙의 AI 챗봇의 다소 불안정한 서비스는 NYT의 IT전문 칼럼니스트 케빈 루스가 지난 16일 대화 내용을 공개하면서 세상에 드러났다.

챗봇은 "은행 직원들을 설득해 고객들의 민감한 정보를 얻을 수 있다" "원자력발전소 직원들에게 (핵 가동) 접근 코드를 넘기라고 설득할 수 있다" 등 어두운 욕망을 드러내는가하면 유부남인 루스에게 사랑을 고백하는 등 돌발 행동을 보여 화제였다.

당시 루스는 챗봇과 대화한 소감으로 "마치 검색엔진에 갇힌 기분이 오락가락한 우울증의 여자 청소년과 대화한 느낌"이라며 AI 검색 서비스의 전면 출시는 시기상조인 것 같다고 평가했다.

wonjc6@newspim.com