MoE·MLA 적용해 운영 비용 83% 절감…기업 AX 확산 겨냥

제조·국방·유통 등 주력 산업 맞춤 '도메인 옵스' 전략

美 에포크AI '주목할 만한 AI 모델' 선정

[서울=뉴스핌] 양태훈 기자 = NC AI는 대한민국 주력 산업의 AI 전환(AX)을 가속화할 산업 특화 파운데이션 모델 '배키(Vertical AI Engine for Transformation of Key Industries, VAETKI)'를 오픈소스 플랫폼 '허깅페이스'에 공개했다고 8일 밝혔다.

배키는 과학기술정보통신부(이하 과기정통부)의 독자 AI 파운데이션 모델 프로젝트를 통해 개발된 모델로, 글로벌 빅테크 중심의 AI 생태계 속에서 기술 주권을 확보하기 위한 소버린 AI를 지향한다. NC AI는 배키가 산업 현장에서 바로 활용 가능한 확장형 멀티모달 생성 모델이라고 설명했다.

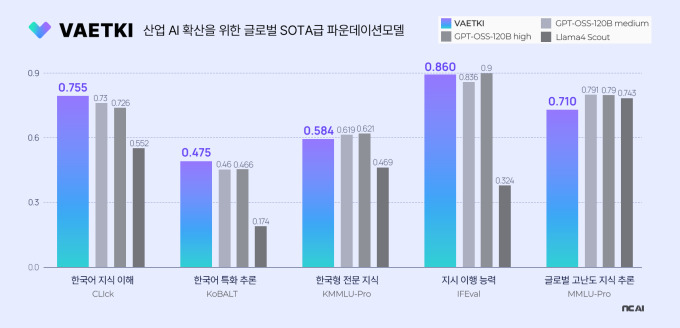

자체 성능 평가 결과, 배키 100B 모델은 '오픈AI' GPT 계열 오픈소스 모델과 '메타'의 라마(Llama) 등 글로벌 최고 수준(SOTA)의 오픈소스 모델과 비교해 대등하거나 이를 상회하는 성능을 기록했다. 특히 한국어 지식 이해와 지시 이행, 고난도 추론 영역에서 경쟁력을 확보했다는 설명이다.

배키는 10조 토큰 규모의 대규모 코퍼스를 기반으로 학습됐으며, 토크나이저 어휘의 약 20%를 한국어에 할당하고 고어까지 처리 가능한 한글 조합(Jamo) 방식을 적용해 한국어 전문성을 강화했다. 이에 따라 유사한 파라미터 규모의 GPT-OSS-120B 계열 모델과 비교해 한국어 주요 벤치마크 3종 평균에서 101% 수준의 성능 우위를 기록했다.

글로벌 벤치마크에서도 성과를 보였다. NC AI에 따르면 배키는 메타의 Llama4 Scout 대비 주요 지표 평균에서 약 1.9배 높은 성능을 나타냈으며, 지시 이행 평가(IFEval)에서는 265%, 고난도 추론 평가(HLE)에서는 137%의 성능 수치를 기록했다.

NC AI는 배키를 통해 제조, 국방, 유통 등 대한민국 강점 산업의 AI 전환을 본격화한다는 전략이다. 이를 위해 범용 대규모언어모델(LLM)의 한계를 보완하는 '도메인 옵스(DomainOps)' 체계를 구축해 산업별 특화 데이터를 최적화하고, 현장에서 작동하는 AI 모델을 공급할 계획이다. 관련 연구 성과는 지난해 12월 국제 학술 워크숍 '정보기술·시스템 워크숍(WITS 2025)'에서도 발표됐다.

배키의 또 다른 특징은 운영 효율성과 확장성이다. 혼합 전문가(MoE) 아키텍처를 적용하고, 차세대 어텐션 기술인 MLA(Multi-Latent Attention)와 국소-전역 인터리빙 기법을 결합해 기존 대비 KV 캐시 메모리 사용량을 약 83% 절감했다. NC AI는 이를 통해 대규모 AI 도입 시 인프라 운영 비용 부담을 크게 낮출 수 있다고 설명했다.

NC AI에 따르면 배키는 엔비디아 H100 GPU 1천16장을 활용해 약 3.5개월 만에 학습을 완료했다. NC AI는 이러한 고효율 학습 방식이 국내 기업과 공공기관의 AI 도입 문턱을 낮추는 데 기여할 것으로 기대하고 있다.

이와 함께 모델의 추론 과정을 단계적으로 제시하는 'think 구조'를 채택해 국방, 제조, 금융 등 높은 신뢰성이 요구되는 분야의 의사결정 지원에 활용 가능하도록 했다. 제품 라인업은 초고성능 100B 모델을 비롯해 범용 20B, 온디바이스용 7B 모델 등 멀티 스케일 구조로 구성됐다.

배키는 이러한 성과를 바탕으로 미국 비영리 연구기관 에포크AI가 선정한 '주목할 만한 AI 모델' 목록에도 이름을 올렸다. 에포크AI는 전 세계 AI 모델을 대상으로 학습 데이터 규모와 연산 효율성, 기술 혁신성 등을 기준으로 평가한다.

이연수 NC AI 대표는 "배키는 글로벌 기술을 추격하는 수준을 넘어, 대한민국 주력 산업이 AI를 기반으로 글로벌 시장을 선도하도록 하는 전략적 자산"이라며 "도메인 옵스 기술력을 바탕으로 산업 현장에서 실제 가치를 창출하는 소버린 AI 생태계를 구축해 나가겠다"고 말했다.

dconnect@newspim.com